Nur ein kleiner Nebenbeikommentar.

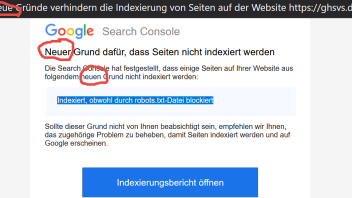

Ich bekomme heute folgende Email, aus der klar wird, wie bescheurt die Denke von G aus Sicht von Usern ist: "Indexiert, obwohl durch robots.txt-Datei blockiert". Nebenbei habe ich an dieser robots.txt schon seit > 1 Jahr nichts mehr geändert.

Die angeblich aktuell betroffene URL

https://ghsvs.de/component/content/category?layout=protostarbs3ghsvs:wookghsvs&Itemid=644

und an der sehe ich, dass die aus frühesten Joomla-3-Zeiten stammt und schon laaaaaange joomlaseitig auf eine 404-Seite führt, laaaange nicht mehr bei mir auftaucht und laaange zusätzlich per robots.txt (Disallow: /component/content/) und einem eigenen Plugin unzugänglich wäre, sogar mit einem 405, wenn es sie denn gäbe

Und entfernt habe ich sie auch schon desöfteren in der Console. Kommt halt immer wieder.

Einzige Möglichkeit wäre also Disallow: /component/content/ aus der robots.txt zu entfernen, Aufrufe radikal ins Leere laufen lassen, abzuwarten, bis auch Google das kapiert UND diverse andere Aufrufe, die G im Jahre 1888 mal gesammelt hat über längere Zeit zu kontrollieren, ob die jetzt blöderweise wieder mit irgendwas Inhalt aufrufbar sind; ohne 404 oder 405.

Das mentale Problem, dass ich damit habe, ist, dass Google die weiterhin, ungewiss ob mit Inhalten oder nicht, beharrlich behält. Und natürlich diese bescheuerten Formulierungen, die auch Kunden immer wieder veranlasst bei mir rückzufragen, was da für eine Katastrophe passiert ist. In meiner Console ist das dann so formuliert, dass diese gesperrte URL meinen Suchergebnissen schaden könnte.