Hallo.

meine bescheidene Meinung:

1. Aktuell rankst du mit der Startseite auf Platz 44, d.h. Google sieht 43 andere Seiten als relevanter an als deine.

2. Schau Dir einfach die Top-Ergebnisse an und du siehst, welche Suchintention Google hier vermutet - die musst du genau treffen, sonst bist du völlig chancenlos.

Wie wichtig die Suchintention ist kannst du ganz einfach überprüfen: Gib Restaurant + eine beliebige Größere Stadt bei Google ein. Du wirst auf den vorderen Plätzen IMMER eine Übersicht verschiedener Restaurants sehen, weil Google davon ausgeht dass jemand der Restaurant + Stadt eingibt eine Auswahl verschiedener Restaurants sehen möchte. Du kannst mit einer Webseite eines Restaurants da nicht vorne reinranken, weil du die Suchintention nicht triffst.

Das Thema Suchintention zu verstehen ist absolut wichtig - du musst dem Besucher genau das bieten was Google hinter der jeweiligen Suchanfrage vermutet. Was das ist, siehst du anhand der Top 10 Ergebnisse.

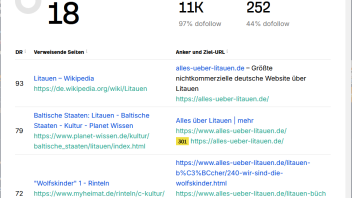

3. Deine Konkurrenten sind Wikipedia, die europäische Union, das Auswärtige Amt, das Land Sachsen-Anhalt usw. - die sind was Reputation / Authorität der Webseiten angeht brutal und nahezu unerreichbar. Aber auch "die kleinen" in den Top 10 haben bereits extrem starke Ahrefs Domain-Ratings.

Hanisauland - 69

lithuania.travel - 69

planet-wissen.de - 79

dw.com - 90

spiegel.de - 91

Du trittst gegen diese Seiten an mit einem Wert von 18.

Selbst mit reichlich Budget und professioneller Unterstützung wäre es schwer da dauerhaft weit vorne zu ranken - die Konkurrenz ist für ein solches Keyword aus meiner Sicht einfach zu stark.

Was kannst du jetzt machen?

Die Seite löschen? ... Nein keinesfalls.

Du solltest dich intensiv mit dem Thema "Longtail Keywords" und "Helpful Content" auseinandersetzen.

Da bist du richtig stark und hast echte Alleinstellungsmerkmale - da kannst du mit Sicherheit richtig gute Ergebnisse erreichen.

Strukturiere deine Inhalte ordentlich und vermarkte sie als eigene Besuche, eigene Reiseerfahrungen (Das können viele andere nicht.. - Stichwort Helpful Content Update).

Ein auf die schnelle rausgesuchtes Beispiel ist das Kernkraftwerk Ignalina - da rankst du schon relativ gut, wenn du so einen Inhalt noch besser aufbereitest und ihn für die Leser gut konsumierbar machst und z.B. mit einer Überschriftenstruktur arbeitest [H1-H6] kanns sogar noch weiter nach vorne gehen.

Mach das für alle deine Inhalte, und mach eine ordentliche Keyword-Recherche um weitere Themen aufzudecken die du bearbeiten kannst, dann kannst du mit der Seite den Traffic durch die Decke jagen!

Tut mir Leid für die etwas deutlichen Worte, ich hoffe sie kommen dennoch nicht falsch bei dir an. Ich meins Dir gut

Genau heute vor einer Woche habe ich in der JUG Online einen Vortrag mit dem Thema "Seo Workshop - Wir ranken ein Keyword" gehalten - da hab ich das was ich dir jetzt mal so ganz schnell in ein paar Zeilen zusammengetippt habe einen ganzen Abend lang sehr ausführlich dargestellt und mit den anderen Teilnehmerinnen und Teilnehmern diskutiert. Die JUG online ist kostenlos, trifft sich 1x monatlich und jeden Monat hält irgendwer einen Vortrag und teilt sein Wissen - ich kann diesen persönlichen Austausch nur empfehlen.